28 avril 2026

Vercel : piratage via Context.ai expose emails, clés API et code source

Vercel : piratage via Context.ai expose emails, clés API et code source

20 avril 2026 — Par Laetitia Lamari et Adrien Naeem

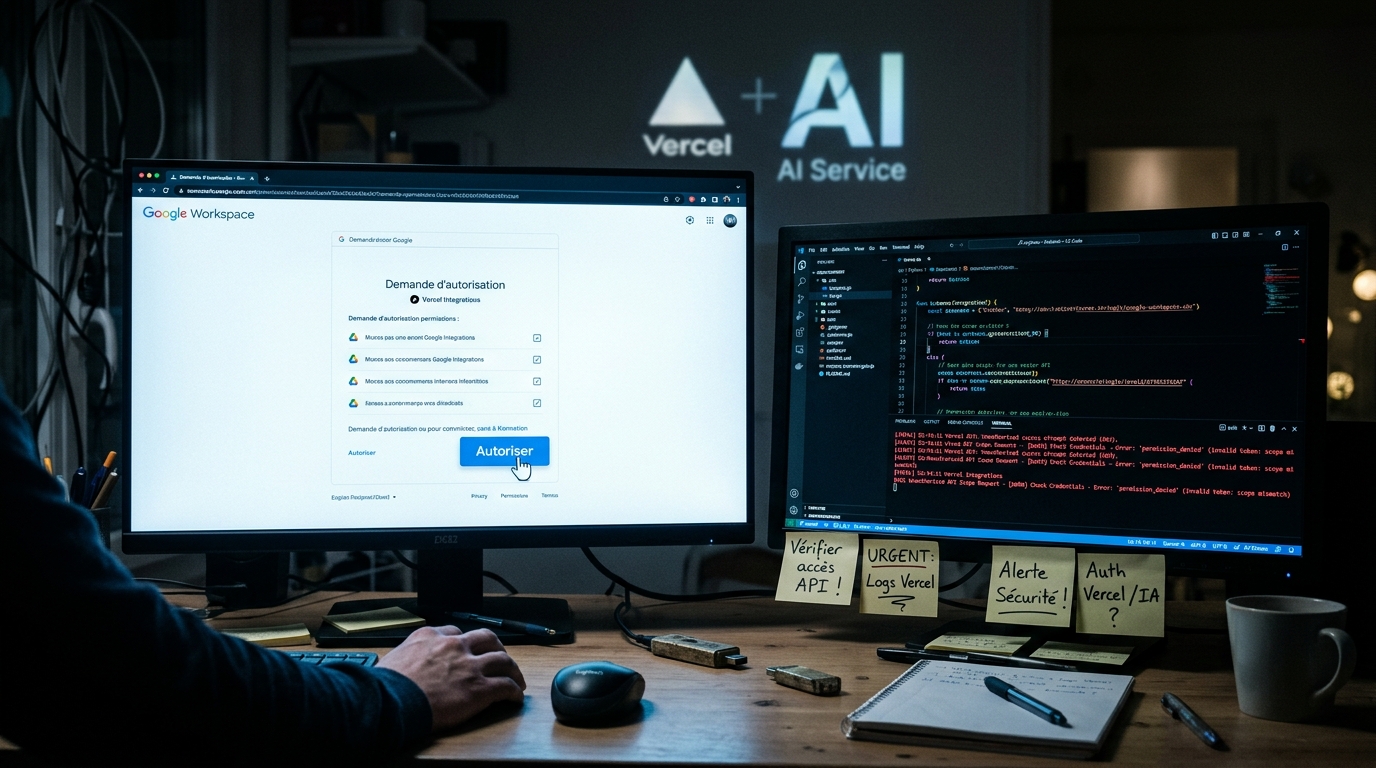

Un incident majeur lié à une intégration d'outil d'intelligence artificielle a entraîné l'exposition d'emails, de fichiers, de clés API et de code source chez Vercel, la plateforme derrière Next.js. La compromission remonte à février : un outil tiers, Context.ai, disposant d'accès complet au Google Workspace d'un employé, a été piraté après l'infection d'un poste par le malware Lumma. Le groupe ShinyHunters a revendiqué la fuite et plusieurs projets crypto hébergés ont dû procéder en urgence à la rotation de leurs identifiants.

Les faits établis

- En février, un employé a autorisé Context.ai avec son compte Google professionnel, accordant à l'application des permissions larges sur le Google Workspace de Vercel (emails, fichiers, agenda, etc.).

- Un employé de Context.ai a téléchargé un malware (Lumma) en cherchant des scripts de triche pour Roblox, ouvrant la porte aux attaquants.

- L'accès obtenu via Context.ai a permis aux pirates de récupérer des clés d'accès, du code source et des données internes.

- ShinyHunters a revendiqué la fuite et mis en vente des éléments volés ; plusieurs projets crypto hébergés sur la plateforme ont procédé à des rotations d'urgence de mots de passe et clés API.

- Vercel a indiqué que le nombre de clients touchés était « assez limité », sans fournir de chiffrement public détaillé.

Ces éléments ont été documentés et rapportés par plusieurs sources spécialisées, qui confirment le mécanisme d'attaque via un tiers disposant d'autorisations larges.

Ce que disent les experts

Adrien Naeem, intervenant sur le dossier, met en garde contre le modèle d'autorisation trop permissif :

« Tu leur donnes accès à tout, absolument tout. Ils ont accès à tes mails, à ton calendrier, à tes informations… » — Adrien Naeem

Il souligne le caractère systémique du risque :

« Ce n'est pas Vercel qui a eu un défaut de sécurité, mais c'est un partenaire à lui qui s'est fait pirater via un employé. Donc il faut faire extrêmement attention. » — Adrien Naeem

Laetitia Lamari, experte interrogée sur les conséquences opérationnelles, insiste pour sa part sur la nécessité d'une gouvernance stricte des intégrations tierces. Selon elle, les entreprises doivent limiter les permissions, journaliser les accès et appliquer des contrôles d'identité renforcés avant d'autoriser des outils externes à toucher des données sensibles.

Enjeux pour les entreprises et recommandations

L'affaire illustre plusieurs enjeux opérationnels et de gouvernance : la facilité d'autoriser des applications, la dépendance aux tiers et la chaîne de responsabilité lorsqu'un fournisseur ou un outil externe est compromis.

Recommandations pratiques (synthèse des préconisations des experts) :

- Appliquer le principe du moindre privilège pour toutes les intégrations d'outils IA et tiers.

- Auditer régulièrement les applications connectées aux suites collaboratives (Google Workspace, Microsoft 365, etc.).

- Mettre en place une traçabilité et des alertes sur les comportements anormaux liés aux comptes disposant de droits étendus.

- Segmenter l'accès aux clés API et éviter le stockage massif de secrets accessibles depuis des postes utilisateurs.

- Former les équipes : les erreurs humaines (installation d'un outil malveillant, clics sur "autoriser") restent l'une des premières causes d'incidents.

Contexte sectoriel

Les outils d'assistance basés sur l'IA se multiplient dans les environnements professionnels et demandent souvent des accès larges pour fonctionner. Leur adoption rapide expose des vecteurs de compromission nouveaux, notamment lorsque la sécurité du fournisseur tiers est moindre ou que des mauvaises pratiques (permissions trop larges, absence de MFA) subsistent.

Pour les plateformes d'hébergement comme Vercel, l'impact concret peut être la fuite de code source et la compromission d'identifiants de clients, en particulier dans l'écosystème crypto où la réactivité et la rotation des clés sont critiques.

Conclusion

L'incident autour de Context.ai et Vercel rappelle que la sécurité ne se limite pas à durcir ses propres systèmes : la chaîne de confiance s'étend aux outils et prestataires auxquels les employés accordent des permissions. « Il faut faire extrêmement attention », avertit Adrien Naeem. La mise en œuvre de politiques d'accès strictes, d'audits et d'une formation ciblée des employés apparaît aujourd'hui comme une exigence minimale pour réduire le risque opérationnel lié aux intégrations IA.

Faits vérifiés à partir des éléments publics disponibles (avril 2026).